|

Опрос

|

реклама

Быстрый переход

Google облегчила жизнь учащимся: визуальный поиск Circle to Search научился решать уравнения

15.05.2024 [01:18],

Владимир Фетисов

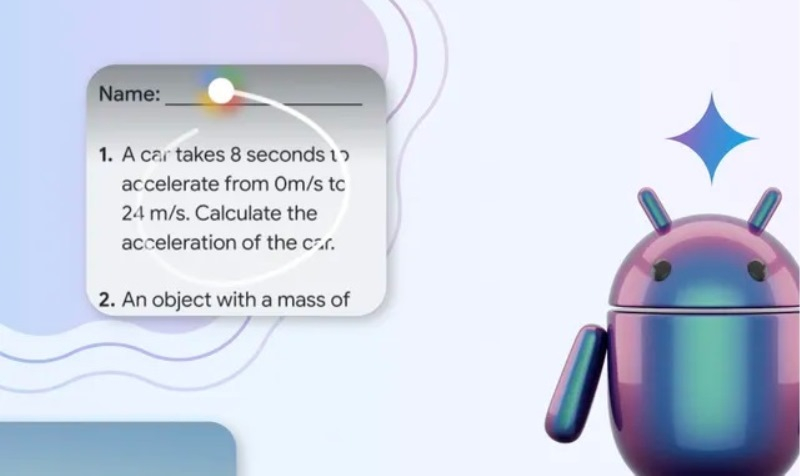

Ранее в этом году Google представила функцию визуального поиска Circle to Search («Обведение для поиска»), которая позволит пользователям Android-смартфонов обвести интересующий фрагмент на экране смартфона и буквально в одно касание получить информацию о нём в поисковике. Теперь же разработчики расширяют возможности данного инструмента, делая его полезным для учащихся, у которых возникли трудности с выполнением заданий по математике или физике.

Источник изображения: Google Используя смартфон или планшет на базе Android учащиеся могут задействовать функцию Circle to Search для решения уравнений. Обведя интересующий пример, пользователь увидит всплывающее окно, в котором будут предоставлены подсказки касательно решения задачи. По заявлению Google, новая опция не сделает всю работу за пользователя, но поможет найти решение, если самостоятельно это сделать не удаётся. Появление ИИ-алгоритмов и быстрый рост их популярности вызвали обеспокоенность среди представителей образовательной сферы. Они посчитали, что учащиеся смогут перекладывать всю работу на нейросети, что существенно скажется на качестве образования. Вероятно, чтобы избежать подобных обвинений Google не стала делать новую функцию таким образом, чтобы пользователь получал готовое решение. Отметим также, что позднее в этом году функция Circle to Search станет полезна при решении сложных математических уравнений и задач, в том числе с формулами, диаграммами, графиками и др. Для реализации новых возможностей визуального поиска Circle to Search разработчики используют ИИ-модель LearnLM. Google представил сверхбыструю ИИ-модель Gemini 1.5 Flash

15.05.2024 [01:13],

Анжелла Марина

Google продолжает расширять свою линейку моделей искусственного интеллекта Gemini. На стартовавшей вчера конференции Google I/O компания анонсировала новую модель, ориентированную на задачи, в которых требуется высокая скорость — Gemini 1.5 Flash. Модель способна обрабатывать данные практически молниеносно, без задержек.

Источник изображения: Google По словам вице-президента Google Labs Джоша Вудворда (Josh Woodward), Gemini 1.5 Flash оптимизирована для «узких, приоритетных задач, где требуется низкая задержка». Нейросеть способна обрабатывать текст, изображения и видео с высокой скоростью. Это делает её идеальной для приложений, требующих мгновенных ответов в режиме реального времени, например для общения с пользователями или клиентами, или мгновенной генерации простых изображений, сообщает издание The Verge. В то же время для задач, не требующих молниеносных ответов, лучше подойдет обновленная модель Gemini 1.5 Pro. Она может анализировать большие объемы текста, делать обобщения и переводы. Gemini 1.5 Pro также получила расширенные возможности машинного логического рассуждения и написания программного кода. Обе модели используют контекстное окно в 1 миллион токенов, что позволяет учитывать больше информации при генерации ответов. Для сравнения, контекстное окно GPT-4 составляет 128 000 токенов. Помимо AI Studio, Gemini 1.5 Pro скоро станет доступна и в Google Workspace. Пользователи смогут использовать возможности модели в почте Gmail и PDF-документах. А подписчики расширенной версии Gemini Advanced получат доступ к модели на 35 языках. Обе модели будут доступны через Google AI Studio и Gemini API в более чем 200 странах, включая Европейский Союз, Великобританию и Швейцарию. Google натравит на телефонных мошенников нейросеть Gemini Nano

15.05.2024 [00:46],

Владимир Фетисов

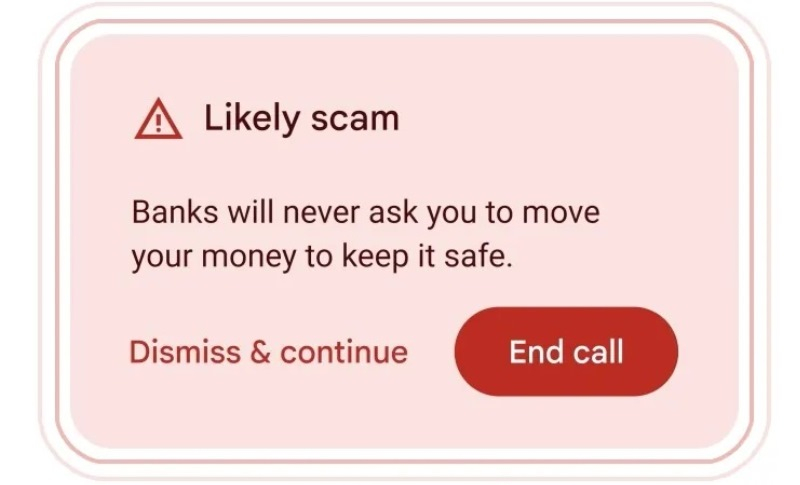

Существуют разные способы борьбы с телефонным мошенничеством, но далеко не все из них эффективны. Компания Google решила подойти к решению этого вопроса с технологической точки зрения и реализовать функцию определения мошеннических звонков на основе большой языковой модели Gemini Nano, которая может полностью работать на пользовательском устройстве.

Источник изображения: Google Функция выявления потенциально мошеннических звонков появится в будущей версии Android. В её основе лежит нейросеть Gemini Nano, которая помогает эффективно выявлять «модели разговора, обычно связанные с мошенничеством» в режиме реального времени. К примеру, часто телефонные мошенники выдают себя за сотрудников банков и пытаются выманить у жертв конфиденциальные платёжные данные. ИИ-алгоритм может определять такое подозрительное поведение, после чего на экране смартфона будет появляться предупреждение о том, что звонок потенциально является мошенническим. Конкретные сроки запуска новой функции для Android озвучены не были. Google лишь сообщила, что она появится в будущем и будет основана на алгоритме Gemini Nano. Однако уже сейчас известно, что Google не будет навязывать инструмент выявления мошеннических звонков, поэтому пользователи при необходимости смогут отключить данную опцию. Это хорошая новость, поскольку хоть Gemini Nano и работает на устройстве пользователя и не передаёт данные на удалённые серверы Google, алгоритм всё же будет прослушивать все разговоры пользователя. Google представила ИИ Veo для создания реалистичных видео — Full HD и больше минуты

14.05.2024 [23:46],

Владимир Фетисов

Около трёх месяцев прошло с тех пор как OpenAI представила генеративную нейросеть Sora, которая может создавать реалистичное видео по текстовому описанию. Теперь у Google есть чем ответить: в рамках конференции Google I/O была анонсирована нейросеть Veo. Алгоритм может генерировать «высококачественные» видеоролики с разрешением Full HD продолжительностью более минуты с применением разных визуальных и кинематографических стилей.

Источник изображения: Google В пресс-релизе Google сказано, что алгоритм Veo обладает «продвинутым пониманием естественного языка», что позволяет ИИ-модели понимать кинематографические термины, такие как «таймлапс» или «съёмка пейзажа с воздуха». Пользователи могут добиться желаемого результата с помощью не только текстовых подсказок, но также «скормить» ИИ изображения или видео, получая в конечном счёте «последовательные и целостные» ролики, в которых на протяжении всего времени движения людей, животных и объектов выглядят реалистично. Генеральный директор ИИ-подразделения Google DeppMind Демис Хассабис (Demis Hassabis) заявил, что пользователи могут корректировать генерируемые ролики с помощью дополнительных подсказок. Кроме того, Google изучает возможность интеграции дополнительных функций, которые позволят Veo создавать раскадровки и более продолжительные видео. Несмотря на сегодняшний анонс Veo, обычным пользователям придётся какое-то время подождать, прежде чем алгоритм станет общедоступным. На данном этапе Google приглашает к тестированию предварительной версии нейросети ограниченно количество создателей контента. Компания хочет поэкспериментировать с Veo, чтобы определить, каким образом следует осуществлять поддержку авторов контента и развивать сотрудничество с ними, давая творческим людям право голоса в разработке ИИ-технологий Google. Некоторые функций Veo в ближайшие несколько недель станут доступны ограниченному числу пользователей сервиса VideoFX, которые подадут заявки на участие в тестировании предварительной версии алгоритма. В будущем Google намерена также добавить некоторые функции Veo в YouTube Shorts. Google анонсировала Gemma 2 — открытую ИИ-модель с 27 млрд параметров

14.05.2024 [23:13],

Владимир Фетисов

Сегодня началась ежегодная конференция для разработчиков Google I/O, в рамках которой уже было представлено немало любопытных новинок, таких как серверный ИИ-процессор Trillium и генератор изображений Imagen 3. Вместе с этим разработчики анонсировали скорое появление модели искусственного интеллекта Gemma 2 с открытым исходным кодом, которая включает 27 млрд параметров. Её запуск должен состояться в июне этого года.

Источник изображения: techcrunch.com Ранее в этом году Google выпустила версии Gemma 2B и Gemma 7B с 2 млрд и 7 млрд параметров соответственно. Появление версии ИИ-модели с 27 млрд параметров можно назвать существенным продвижением в развитии этого алгоритма. Во время презентации вице-президент Google Labs Джош Вудворд (Josh Woodward) рассказал, что ИИ-модели Gemma были загружены более «миллиона раз» в разные сервисы, где и продолжают работать. Он подчеркнул, что новая версия нейросети Gemma 2 предложит лучшую в отрасли производительность в компактных размерах благодаря оптимизации для работы на графических процессорах Nvidia следующего поколения или одном хосте Google Cloud TPU в сервисе Vertex AI. Размер большой языковой модели может отойти на второй план, если окажется, что она работает не слишком качественно. Google ещё не раскрыла подробностей касательно алгоритма Gemma 2. Это означает, что оценить его качество, вероятно, можно будет только после того, как ИИ-модель попадёт в руки разработчиков. По заявлениям Google, ИИ-модель Gemma 2 превосходит в плане производительности вдвое более крупные модели. В Google Chrome для компьютеров встроят ИИ-модель Gemini Nano — она будет работать локально

14.05.2024 [22:47],

Владимир Фетисов

Компания Google анонсировала появление ИИ-модели Gemini Nano в браузере Chrome для компьютеров. Большая языковая модель станет частью фирменного интернет-обозревателя компании начиная с Chrome 126.

Источник изображения: Firmbee / Pixabay По заявлению Google, упомянутое нововведение позволит сторонним разработчикам реализовывать собственные ИИ-функции на основе большой языковой модели, работающей локально на устройствах пользователей. Сама Google планирует задействовать Gemini Nano для реализации ряда функций, таких как Help Me Write в Gmail на платформе Workspace Lab, помогающей генерировать полноценные электронные письма по кратким подсказкам или же сообщения по заданным критериям. Google заявила, что реализация поддержки WebGPU и WASM в Chrome позволяет ИИ-моделям работать с разумной скоростью на компьютерах с разными аппаратными конфигурациями. В дополнение к этому компания ведёт переговоры с разработчиками других браузеров, предлагая им интегрировать созданные в Google ИИ-функции в свои продукты. «Мы начали взаимодействовать с другими браузерами и откроем программу раннего предварительного доступа для разработчиков. С WebGPU, WASM и Gemini, встроенными в Chrome, мы считаем, что интернет готов к использованию искусственного интеллекта», — заявил директор по управлению продуктами Chrome в Google Джон Дальке (Jon Dahlke) во время брифинга перед началом конференции Google I/O, которая проходит в эти дни в Маунтин-Вью, США. Трудно сказать, будут ли сторонние разработчики заинтересованы в использовании ИИ-моделей Google в своих браузерах. Тем не менее, такой подход позволит реализовать полезные и востребованные функции, такие как перевод в реальном времени, поиск информации в разных источниках и обобщение собранных данных, помощь в написании сообщений и др. Google представила мощнейший серверный ИИ-процессор Trillium — почти в пять раз быстрее предшественника

14.05.2024 [22:21],

Николай Хижняк

В рамках конференции Google I/O компания Google представила шестое поколение своего фирменного тензорного процессора (Tensor Processing Unit) с кодовым названием Trillium. Он предназначен для центров обработки данных, ориентированных на работу с искусственным интеллектом. По словам компании, новый чип почти в пять раз производительнее предшественника.

Источник изображения: The Verge «Промышленный спрос на компьютеры для машинного обучения вырос в миллион раз за последние шесть лет и каждый год продолжает увеличиться в десять раз. Я думаю, что Google была создана для этого момента. Мы являемся новаторами в разработке чипов для искусственного интеллекта уже более десяти лет», — заявил генеральный директор Alphabet Сундар Пичаи (Sundar Pichai) в разговоре с журналистами. Разрабатываемые Alphabet, материнской компанией Google, специализированные чипы для центров обработки данных, ориентированных на ИИ, представляют собой одну из немногих жизнеспособных альтернатив решениям компании Nvidia. Вместе с программным обеспечением, оптимизированным для работы с тензорными процессорами Google (TPU), эти решения позволили компании занять значительную долю на рынке. По данным издания Reuters, Nvidia по-прежнему доминирует на рынке чипов для ИИ-дата-центров с долей 80 %. Значительная часть от оставшихся 20 % приходятся на различные версии TPU от Google. В отличие от Nvidia, компания Google не продаёт свои процессоры, а использует их сами и сдаёт в аренду облачные вычислительные платформы, которые на них работают. Для шестого поколения TPU под названием Trillium компания заявляет прибавку вычислительной производительности в 4,7 раза по сравнению с TPU v5e в задачах, связанных с генерацией теста и медиаконтента с помощью больших языковых моделей ИИ (LLM). При этом Trillium на 67 % энергоэффективнее, чем TPU v5e, отмечают в компании. Как пишет портал TechCrunch, значительного увеличения производительности у Trillium компания смогла добиться благодаря увеличения количества используемых матричных умножителей (MXU), а также повышения тактовой частоты чипа. Кроме того, компания удвоила для Trillium пропускную способность памяти. Более конкретных технических деталей Trillium не приводится. Вычислительные мощности нового процессора станут доступны для клиентов облачных сервисов Google к «концу 2024 года», отмечают в компании. Однако от решений Nvidia компания Google не отказывается. В рамках конференции Google I/O также было заявлено, Google станет одним из первых облачных провайдеров, который с начала будущего года будет предлагать облачные услуги на базе специализированных ИИ-ускорителей нового поколения Nvidia Blackwell. Google представила Gemini Live — ИИ-ассистента с памятью, естественной речью и компьютерным зрением

14.05.2024 [22:12],

Андрей Созинов

Во вторник на конференции Google I/O 2024 была анонсирована новая возможность для ИИ-чат-бота Gemini — функция Gemini Live, которая позволяет пользователям вести «углубленные» голосовые диалоги с Gemini на своих смартфонах. Пользователи могут прерывать Gemini во время его реплик, чтобы задать уточняющие вопросы, и чат-бот будет адаптироваться к речи пользователя в режиме реального времени. Кроме того, Gemini может видеть и реагировать на окружение пользователя, используя фотографии или видео, снятые камерами смартфонов.

Источник изображений: Google Gemini Live — это в некотором роде соединение платформы компьютерного зрения Google Lens и виртуального помощника Google Assistant, и их дальнейшая эволюция. На первый взгляд Gemini Live не кажется кардинальным обновлением по сравнению с существующими технологиями. Но Google утверждает, что система использует новые методы генеративного ИИ, чтобы обеспечить превосходный, менее подверженный ошибкам анализ изображений, и сочетает эти методы с улучшенным речевым движком для более последовательного, эмоционально выразительного и реалистичного многооборотного диалога. Технические инновации, используемые в Gemini Live, частично связаны с проектом Project Astra, новой инициативой DeepMind по созданию приложений и «агентов» на базе ИИ с поддержкой «понимания» в реальном времени различных источников данных — текста, аудио и изображения. «Мы всегда хотели создать универсального агента, который будет полезен в повседневной жизни, — сказал на брифинге Демис Хассабис (Demis Hassabis), генеральный директор DeepMind. — Представьте себе агентов, которые могут видеть и слышать то, что мы делаем, лучше понимать контекст, в котором мы находимся, и быстро реагировать в разговоре, делая темп и качество взаимодействия гораздо более естественными». Gemini Live, который будет запущен только в конце этого года, сможет отвечать на вопросы о предметах, находящихся в поле зрения (или недавно попавших в поле зрения) камеры смартфона, например, в каком районе находится пользователь или как называется сломавшаяся деталь велосипеда. Либо пользователь сможет указать системе на часть компьютерного кода, а Live объяснит, за что она отвечает. А на вопрос о том, где могут находиться очки пользователя, Gemini Live скажет, где он видел их в последний раз. А как это облегчит поиск потерянного пульта от телевизора! Live также сможет стать своеобразным виртуальным наставником, помогая пользователям отрепетировать речь к мероприятию, обдумать идеи и так далее. Live может подсказать, какие навыки следует подчеркнуть на предстоящем собеседовании или стажировке, или дать совет по публичному выступлению. Способность Gemini Live «запоминать», что происходило недавно, стала возможной благодаря архитектуре модели, лежащей в ее основе — Gemini 1.5 Pro, а также, но в меньшей степени, других «специфических» генеративных моделей. У Gemini 1.5 Pro весьма ёмкое контекстное окно, а значит, она может принять и обработать большое количество данных — около часа видео — прежде чем подготовить ответ. В Google отметили, что Gemini Live будет помнить всё, что происходило в последние часы. Gemini Live напоминает генеративный ИИ, применяемый в очках Meta✴, которые аналогичным образом могут просматривать изображения, снятые камерой, и интерпретировать их практически в реальном времени. Судя по демонстрационным роликам, которые Google показала во время презентации, Live также очень похож на недавно обновленный ChatGPT от OpenAI. Ключевое различие между новым ChatGPT и Gemini Live заключается в том, что решение от Google не будет бесплатным. После запуска Live будет эксклюзивом для Gemini Advanced, более сложной версии Gemini, которая доступна подписчикам плана Google One AI Premium Plan, стоимостью 20 долларов в месяц. Возможно, в качестве отсылки к очкам Meta✴, в одном из демонстрационных роликов Google был показан человек в AR-очках, оснащенных приложением, похожим на Gemini Live. Правда, компания Google, желая избежать очередного провала в сфере умных очков, отказалась сообщить, появятся ли этот или подобный продукт с генеративным ИИ на рынке в ближайшем будущем. Google анонсировала свой самый мощный ИИ-генератор изображений Imagen 3

14.05.2024 [22:03],

Владимир Фетисов

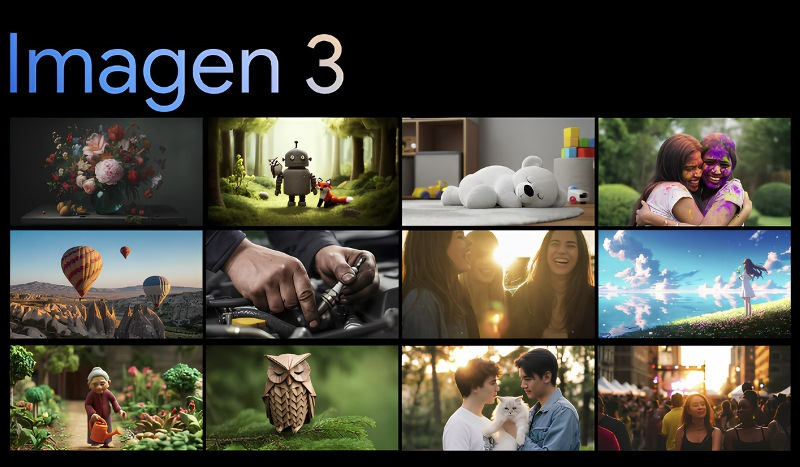

В рамках проходящей в эти дни в Маунтин-Вью конференции Google I/O состоялся анонс новой версии генеративной нейросети семейства Imagen. Речь идёт об алгоритме Imagen 3 — самом продвинутом генераторе изображений от Google на данный момент.

Источник изображения: Google Глава исследовательского ИИ-подразделения Google Deep Mind Демис Хассабис (Demis Hassabis) во время презентации заявил, что Imagen 3 более точно понимает тестовые запросы, на основе которых он создаёт изображения, чем модель Imagen 2. Он отметил, что алгоритм работает более «креативно и детализировано», а также реже ошибается и создаёт меньше «отвлекающих артефактов». Вместе с этим Google попыталась развеять опасения по поводу того, что Imagen 3 будет использоваться для создания дипфейков. В процессе генерации изображений будет задействована технология SynthID, посредством которой на медиафайлы наносятся невидимые криптографические водяные знаки. Предполагается, что такой подход сделает бесполезными попытки использовать ИИ-генератор Google для создания фейкового контента. Частные пользователи могут оформить подписку на Imagen 3 через сервис Google ImageFX. Разработчики и корпоративные клиенты получат доступ к ИИ-генератору через платформу машинного обучения Vertex AI. Как и в прошлом, в этот раз Google не поделилась подробностями касательно того, какие данные использовались для обучения нового алгоритма. В Chrome обнаружена шестая за год критическая уязвимость нулевого дня

14.05.2024 [20:55],

Сергей Сурабекянц

В шестой раз в 2024 году и второй раз за неделю в интернет-обозревателе Google Chrome обнаружена критическая уязвимость нулевого дня, требующая немедленного обновления браузера. Информация об уязвимости была опубликована 9 мая 2024 года. Она получила «высокую» степень опасности и была зарегистрирована исследователями безопасности как CVE-2024-4761: «Запись за пределы в V8». Согласно информации Google, данный эксплойт использовался злоумышленниками.

Источник изображения: Pixabay На данный момент Google ограничила доступ к подробностям об уязвимости CVE-2024-4761 до тех пор, пока большинство пользователей не получат исправления. Несмотря на регулярно появляющуюся информацию об уязвимостях Chrome, он по-прежнему с большим отрывом остаётся браузером номер один на планете как на мобильных, так и на настольных платформах. Google настоятельно рекомендует пользователям немедленно обновить Chrome. Для этого нужно открыть пункт меню «Параметры» —> «Справка» —> «О Google Chrome», дождаться загрузки обновления, а затем перезапустить браузер. Google создала ChromeOS, которая запускается на смартфонах Pixel

14.05.2024 [14:03],

Владимир Фетисов

По сообщениям сетевых источников, компания Google работает над реализацией возможности запуска операционной системы ChromeOS на смартфонах семейства Pixel. Вероятно, в компании считают, что наличие ChromeOS параллельно с Android может существенно расширить варианты использования мобильных гаджетов, что может оказаться полезным, например, в корпоративной среде.  В сообщении сказано, что не так давно Google провела закрытое мероприятие, в рамках которого продемонстрировала участникам смартфон Pixel 8, работающий под управлением ChromeOS. Для реализации этого был задействован инструмент Android Virtualization Framework, который впервые появился в Android 13. Этот инструмент позволяет запустить виртуальную изолированную среду для установки второй ОС. Очевидно, что выбор пал на ChromeOS не только потому, что эта платформа принадлежит Google, но и потому, что она используется на устройствах гораздо менее производительных, чем современные смартфоны. Также известно, что в ходе проведённой Google демонстрации использовалась особым образом оптимизированная версия ChromeOS. При этом представители Google не упоминали о намерении сделать упомянутую функцию общедоступной. Вместо этого компания предлагает её сторонним производителям смартфонов в качестве инструмента для запуска Android и ChromeOS на одном устройстве. Google ответила на GPT-4o демонстрацией коммуникативных способностей Gemini — нейросеть ведёт диалог как человек

14.05.2024 [14:01],

Анжелла Марина

Вслед за презентацией модели GPT-4o от OpenAI, компания Google продемонстрировала коммуникативные способности нейросети Gemini на Pixel. Демонстрационное видео, показанное перед конференцией Google I/O, производит сильное впечатление. Gemini ведет разговор с пользователем и делает логические выводы без малейших задержек и ошибок.

Источник изображения: Solen Feyissa/Unsplash Как пишет Tom’s Guide, в демо Gemini отвечает на вопросы о происходящем на подготавливаемой сцене для мероприятия. Он правильно определяет, что это сцена для предстоящей конференции Google I/O, и дает краткое описание этого ежегодного события. Подобно недавней демонстрации ChatGPT, видео с Gemini впечатляет естественностью диалога. Кажется, будто за голосом стоит человек, а не искусственный интеллект. Обе модели демонстрируют огромный прогресс в разработке ИИ за последнее время.

Тем не менее, Google не раз критиковали за чрезмерно оптимистичное представление своих разработок в области ИИ. В прошлом некоторые анонсированные функции на практике оказались менее впечатляющими. Поэтому еще предстоит дополнительное тестирование, чтобы понять реальные возможности и ограничения системы. В то же время успехи Google и OpenAI вызывают опасения у экспертов и общественных деятелей. Особенно в контексте недавнего скандала с моделью LaMDA от Google, которая, по утверждению инженера этой компании, «обрела сознание». Хотя большинство ученых опровергают эту гипотезу, вопросы этики и безопасности подобных систем остаются открытыми. Например, ChatGPT от OpenAI уже продемонстрировал способность к предвзятости, токсичности и распространению дезинформации. А Gemini, вероятно, унаследует эти недостатки от GPT-4, учитывая общие принципы работы нейросетевых моделей. Помимо этого, появление ИИ, способного проходить тест Тьюринга и имитировать человеческое поведение, открывает дорогу для злоупотреблений. Например, использование таких систем для автоматического распространения фейковых новостей и социальной инженерии или внедрение в цифровые продукты «дружелюбных» ботов, манипулирующих пользователями в интересах компаний. Система 3D-видеосвязи Google Project Starline выйдет в 2025 году

14.05.2024 [08:20],

Николай Хижняк

Компания Google сообщила, что программно-аппаратный комплекс для видеосвязи Project Starline всё же выйдет на рынок. Google будет продвигать новую технологию при поддержке компании HP Inc.

Источник изображения: Google Представленный в 2021 году Project Starline предназначен для придания общению по видеосвязи максимально реалистичного характера. Благодаря использованию ИИ, 3D-сканирования и ряда технологий Project Starline формирует трёхмерное изображение собеседника, создавая впечатление, будто он находится рядом на расстоянии вытянутой руки. В своей последней итерации Project Starline представляет собой экран, оснащённый различными датчиками и камерами, позволяющими формировать трёхмерное изображение собеседника. «После тысяч часов тестирования в офисах Google, а также нашими корпоративными партнёрами мы поняли, что по сравнению с традиционными видеозвонками встречи в Starline более иммерсивные и похожи на пребывание в одной комнате с собеседником. В Starline люди ведут себя так, будто они находятся рядом друг с другом, а не за многие тысячи километров друг от друга», — отмечает компания в своём официальном блоге. Google сообщает, что собирается поставить технологию Project Starline на коммерческие рельсы в 2025 году при поддержке компании HP Inc. Google также хочет интегрировать Starline непосредственно в сервисы для видеоконференцсвязи, такие как Google Meet и Zoom. Apple и Google начали сообща бороться с тайной слежкой через Bluetooth-трекеры

14.05.2024 [06:43],

Дмитрий Федоров

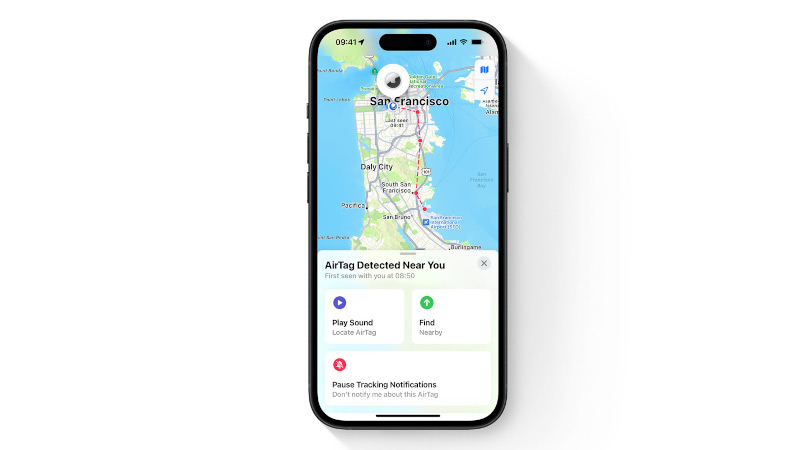

Apple и Google объединили усилия для борьбы со слежкой за людьми с использованием Bluetooth-трекеров. Теперь iPhone и Android-смартфоны будут предупреждать пользователей о нахождении поблизости беспроводного трекера, если пользователь не знал, что за ним следят, и хочет это прекратить.

Источник изображений: Apple Новая инициатива направлена на устранение недостатков беспроводных трекеров, таких как Apple AirTag и Tile. Эти устройства, полезные для поиска потерянных или украденных вещей и показывающие их местоположение на цифровой карте, также могут использоваться злоумышленниками для слежки за жертвами. Обе компании уже внедрили эти оповещения в обновлённые версии своих мобильных операционных систем (ОС), начиная с iOS 17.5 для iPhone и Android-устройств с версией 6.0 или более новой. Их пользователи будут получать сообщение о нахождении Bluetooth-трекера, который перемещается вместе с ними. Пользователи могут включить звуковой сигнал, чтобы такой трекер было легче найти, а также получить инструкции по его отключению.  Когда в 2021 году Apple представила AirTag, они быстро завоевали популярность среди пользователей, которые прикрепляли их к ключам, багажу и даже автомобилям. Это позволяло им использовать глобальную сеть устройств Apple и краудсорсинговые сигналы Bluetooth для быстрого поиска предметов, например, багажа, потерянного во время авиаперелёта. Однако эти устройства также использовались в преступных целях. Некоторые жертвы заявляли, что им подбрасывали беспроводные метки Apple AirTag в баре с целью слежки. С тех пор Apple совместно с Google работает над интеграцией предупреждений и уведомлений в iOS и Android для предотвращения неправомерного использования беспроводных трекеров. Предупреждения о перемещении AirTag вместе с пользователем были внедрены в Android ещё в 2022 году. На данный момент AirTag является лишь одной из моделей Bluetooth-трекеров, представленных на рынке. Хотя Apple и Google ещё работают над созданием отраслевой спецификации для подобных устройств, они разрешают сторонним компаниям, таким как Chipolo, Motorola и другим, создавать свои собственные Bluetooth-устройства для отслеживания местоположения. Однако сторонние компании, создавая совместимые с Find My трекеры, должны соответствовать спецификациям Apple и Google, которые теперь требуют наличия уведомлений о нежелательной слежке. Успех Google Pixel грозит крахом смартфонному бизнесу Sony

13.05.2024 [15:37],

Владимир Мироненко

Компании Google удалось добиться реального успеха в бизнесе по выпуску смартфонов с помощью аппаратов серии Pixel. Но это не сулит ничего хорошего для Sony, поскольку продажи смартфонов Xperia активно сокращаются даже в Японии как раз под давлением Pixel, пишет агентство Bloomberg. Источник изображения: 9to5Google Как отметило информационное агентство, Sony уже давно присутствует на рынке Android-смартфонов, но ей так не удалось добиться серьёзного признания на международном рынке и лишь в Японии её устройства пользуются популярностью у некоторой группы пользователей. Но и здесь, как отмечает Bloomberg, Sony сейчас испытывает трудности, поскольку её смартфоны вытесняются устройствами семейства Google Pixel. За последние несколько лет популярность смартфонов Google Pixel в Японии значительно возросла. В июле 2023 года Япония стала крупнейшим рынком Google для Pixel, а через несколько месяцев появились сообщения о том, что Google активно отбирает долю местного рынка у смартфонов iPhone. Согласно данным аналитиков, продажи Google Pixel в Японии в 2023 году выросли более чем на 500 %. Вместе с тем, как сообщает аналитик IDC Инбе Масафуми (Masafumi Inbe), продажи смартфонов Sony в Японии упали в прошлом году на 40 % и в этом году падение может оказаться таким же. По данным IDC, основной демографической группой пользователей Xperia являются люди в возрасте от 40 лет и старше. Sony пытается привлечь и более молодую аудиторию, но в Японии основным выбором для молодёжи являются смартфоны Apple iPhone. И всё же Sony пока не собирается сдаваться. В 2023 году японская компания заключила «многолетнюю» сделку с Qualcomm по поводу использования её чипов в смартфонах Xperia, а недавно в интернете появились утёкшие изображения Xperia 1 VI, анонс которого состоится 15 мая. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |